В современном информационном мире, где интернет играет огромную роль, поисковые роботы стали его неотъемлемой частью. Но мало кто задумывается о том, зачем они нужны и как они помогают поисковым системам. Давайте разбираться!

Что такое поисковый робот и зачем он нужен

Поисковый робот (также известный как «паук», «бот» или краулер») представляет собой программу, которая автоматически обходит сайты в интернете, индексирует их содержимое и создает базу данных для использования поисковой системой.

Роботы передают все данные поисковой системе, где они обрабатываются, индексируются и используются для показа в поисковой выдаче по соответствующим запросам.

Если робот не просканировал ваш сайт и не добавил в базу, то он не будет отображаться в поиске. Зайти на ваш сайт можно будет только по прямой ссылке.

Не все поисковые роботы работают одинаково, соответственно и скорость индексации у них будет разная. Например, роботы Google могут просканировать новую страницу за пару часов, а у Яндекс это займет несколько дней. Но об отличиях поисковых систем поговорим позже.

Поисковые роботы не просто заглядывают на веб-сайт однажды и забывают о нем – они являются активными наблюдателями и информируют поисковые системы о любых изменениях, а также об удалении или перемещении уже проиндексированных страниц.

Частота обхода зависит от различных факторов, таких как объем трафика, размер, структура сайта и регулярность обновления контента. Таким образом, роботы постоянно следят за актуальностью информации и стараются поддерживать свежий поисковый индекс.

Как работают поисковые роботы

Поисковый робот базируется на сочетании программного обеспечения и алгоритмов, которые позволяют ему обходить и индексировать веб-сайты.

Вот некоторые основные компоненты, лежащие в основе поискового робота.

-

Web-скрейпинг

Это процесс автоматического сбора данных с веб-страниц. Роботы используют web-скрейпинг для извлечения текстового содержимого, ссылок, заголовков, метаданных и других элементов со страниц сайта.

-

Конвейерная обработка

Роботы работают по принципу конвейера, где каждая стадия обработки выполняется последовательно. Например, алгоритм может включать загрузку страницы, извлечение контента, обработку ссылок и индексацию.

-

Алгоритмы обхода

Роботы используют алгоритмы обхода, чтобы определить, какие страницы посетить и в каком порядке. Также они могут включать следование по ссылкам, проверку sitemap или использование других методов для обнаружения новых страниц.

Работа поискового робота обычно состоит из нескольких этапов – вот основные:

Планирование. На этом этапе определяется порядок обхода и индексации веб-сайтов. Планировщик устанавливает приоритеты для различных задач робота, определяет периодичность обхода и принимает решения о распределении ресурсов.

Обход (Crawling). Робот обходит веб-сайты с помощью автоматического процесса, известного как «скрейпинг». Он переходит по ссылкам, начиная с известных точек входа, и собирает информацию с каждой посещенной страницы.

Обход может осуществляться в ширину (обход всех ссылок на текущей странице перед переходом на следующую) или в глубину (переход на каждую ссылку на странице перед возвратом к исходной странице).

Индексация. Собранная информация обрабатывается и индексируется. Робот извлекает текстовое содержимое, метаданные, ссылки, изображения и другие данные со страницы. Эта информация сохраняется в поисковой базе данных (индексе), которая позволяет быстро находить страницы в ответ на поисковые запросы.

Обновление и переиндексация. Роботы периодически повторяют процесс обхода и индексации для обновления информации о веб-сайте.

Оценка и ранжирование. После индексации роботы могут проводить оценку и ранжирование страниц, используя различные алгоритмы и факторы, такие как релевантность контента, качество ссылок, авторитетность и доверие сайта. Это позволяет поисковой системе отображать наиболее релевантные результаты поиска пользователю.

Каждый из этих этапов важен для эффективной работы поискового робота и обеспечения актуальных результатов поиска.

Больше статей на схожую тематику:

Как быстро поисковые роботы индексируют сайты и что на это влияет

Новостные сайты и блоги проверяются роботами поисковиков каждые несколько часов. Но если вы владелец нового сайта, то время значительно увеличивается и придется ждать больше двух недель. К счастью, на скорость индексации сайта можно повлиять.

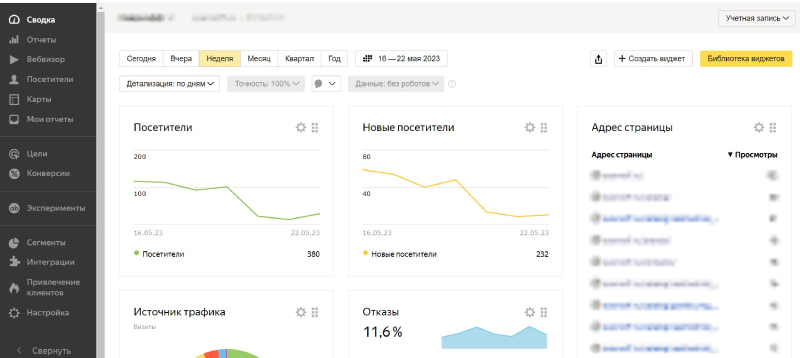

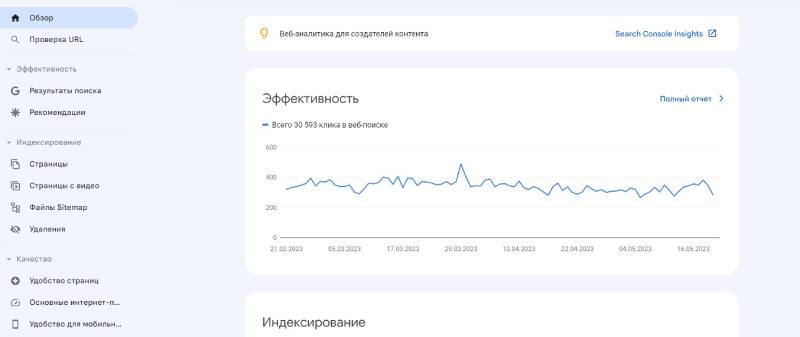

Для ускорения индексации рекомендуется внедрить системы аналитики, такие как Яндекс Метрика и Google Analytics.

Следующим шагом является подключение сайта к Google Search Console и Яндекс Вебмастеру.

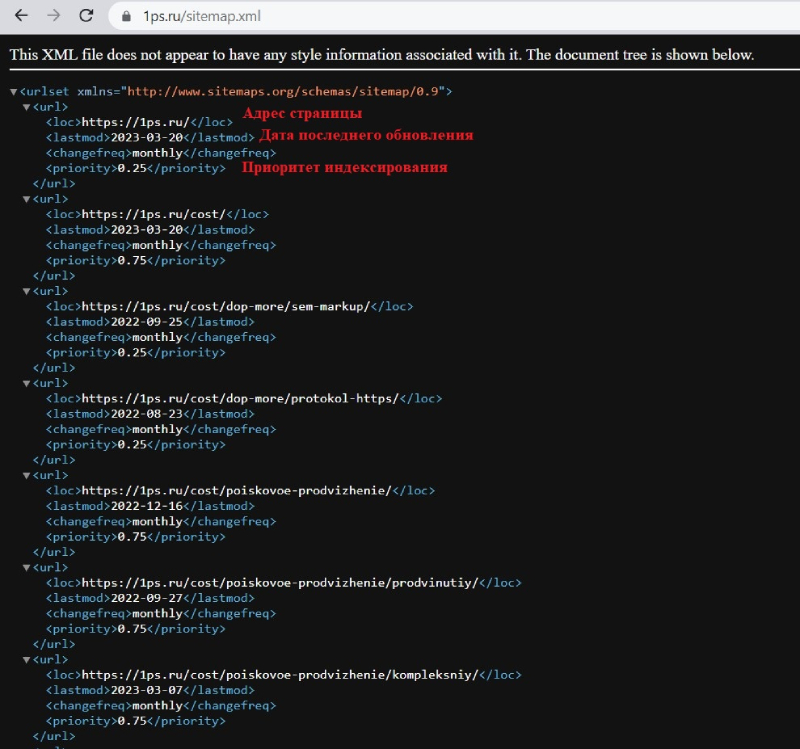

Для повышения эффективности обхода ресурса полезно использование файлов Sitemap и robots.txt.

Файл robots.txt является текстовым файлом на сайте, который указывает инструкции для поисковых роботов относительно того, какие страницы или разделы сайта следует обходить или игнорировать.

Он позволяет вебмастерам контролировать доступ роботов к определенным частям сайта. Sitemap содержит список страниц сайта, которые необходимо проиндексировать.

Метатеги, такие как "noindex" и "nofollow", могут использоваться на страницах сайта для указания роботам об отмене индексации определенных ссылок на странице. Это может быть полезно для скрытия конфиденциальной информации или предотвращения индексации временных или дублирующихся страниц.

На скорость обхода влияет так же техническое состояние сайта. Подробнее о самых распространённых ошибках мы рассказали в статье.

Все эти компоненты позволят ускорить процесс индексации множества веб-страниц и обеспечить актуальность и полноту поисковой базы данных.

Примеры роста кликов, конверсий, заказов и прибыли:

Сравнение поисковых роботов Google и Яндекс

YandexBot и GoogleBot – самые известные веб-пауки, принадлежащие популярным поисковым системам. Это не единственные роботы, которые существуют, например у Google также есть Googlebot-Image для изображений, Googlebot-News для пополнения списков новостного портала и Googlebot-Video для видеоконтента.

Чтобы разобраться в отличиях роботов Google и Яндекс, рассмотрим таблицу:

| Яндекс | ||

|---|---|---|

| Для чего лучше использовать поисковик | Google идеален для поиска узконаправленной информации или документов на иностранных языках. | Яндекс рекомендуется использовать для поиска товара или услуги |

| Внешние ссылки | Важны больше, ценится количество и качество. Для Google по-прежнему важно наращивать ссылочный профиль сайта. Это можно наблюдать, проанализировав результаты поисковой выдачи, где часто встречаются ресурсы с большим количеством внешних ссылок. |

Важны меньше, ценится качество. В Яндексе подход к ссылкам имеет свои особенности: большее внимание уделяется их качеству и естественности, когда пользователи сами активно ссылаются на ресурс. Излишняя активность в наращивании ссылочного профиля может привести к санкциям. |

| Региональность | Google не обеспечивает региональную привязку, и единственной опцией является указание страницы в качестве региона. Однако регистрация в сервисе «Google Мой Бизнес» может улучшить ситуацию. | В Яндексе ситуация иная: для привязки региона к сайту достаточно добавить региональную информацию в Яндекс Вебмастере и Яндекс Справочнике. Это позволяет ресурсу ранжироваться в локальной выдаче. Точная региональная привязка способствует эффективному продвижению всех региональных поддоменов. |

| Коммерческие факторы (совокупность элементов сайта, влияющих на то, решит ли пользователь купить товар или заказать услугу и получится ли у него это сделать) | Google не придает большого значения коммерческим факторам в ранжировании. Даже если улучшить их, всё это не даст такого эффекта, как размещение внешних ссылок. | Яндекс, наоборот, уделяет сильное внимание коммерческим факторам ранжирования. Например, важны цены, контактная информацию, ассортимент товаров и отзывы и т.д. |

| Поведенческие факторы (параметры, которые отражают поведение пользователей на сайте. Они включают такие показатели, как время пребывания на сайте, количество просмотренных страниц, повторные посещения, активность взаимодействия с сниппетами, возврат к результатам поиска и многое другое.) | В Google поведенческие факторы так же учитываются, но имеют несколько меньший вес. | Важны для продвижения. Яндекс анализирует поведенческие факторы для определения качества ресурса. Если метрики имеют высокие показатели, это является ясным сигналом того, что сайт полностью отвечает потребностям пользователей, а значит, увеличивает шансы попасть в топ поисковой выдачи. Однако не стоит пытаться искусственно увеличить поведенческие факторы, так как это может привести к санкциям и потере позиций на продолжительный период. Нет точной информации о том, какие алгоритмы использованы поисковыми системами для ранжирования, но многие эксперты считают, что поведенческие факторы в Яндексе занимают одно из ведущих мест среди самых важных факторов ранжирования. |

| Контент | Ценятся статьи с обширным объемом информации и актуализация контента. Google также обращает внимание на экспертность контента, особенно в тематиках, связанных со здоровьем или благосостоянием пользователей, таких как медицина, финансы и юридические услуги. Владельцам таких ресурсов крайне важно нанимать профессионалов для написания статей и предоставлять копирайтерам возможность консультироваться с экспертами. Также рекомендуется указывать имя и достижения этих экспертов на странице. |

Для достижения успеха в Яндексе требуется создание уникального и незаспамленного контента, свободного от ошибок и опечаток. Объем текста не имеет большого значения для Яндекса: даже страница с тысячей символов может успешно продвигаться в поисковой выдаче. Это особенно полезно для интернет-магазинов, где товарные карточки не требуют большого количества текста. То же самое относится и к обновлению контента: если материал является качественным и актуальным, он может оставаться в топе без дополнительных обновлений на протяжении многих лет. Главное, чтобы контент по-прежнему помогал решать проблемы аудитории. |

| Санкции | Санкции за отсутствие мобильной версии, большое количество битых ссылок, пользовательский спам и манипулирование размерами сниппета. Санкции за заспамленность текстов не такие строгие. За накрутку ПФ санкций нет, по крайней мере каких-нибудь заметных. | Строгие санкции за накрутку поведенческих факторов. Внимание к заспамленности текстов. Также есть санкции за надоедливую рекламу и взрослый контент. |

| Фильтры | Google предлагает различные фильтры и алгоритмы для обеспечения безопасного и релевантного использования своих продуктов и сервисов. Фильтр SafeSearch блокирует нежелательный и неуместный контент, включая взрослый контент, насилие и порнографию. Алгоритм Google Penguin борется с низкокачественными ссылками и спамом, наказывая сайты, использующие нечестные тактики для повышения своего ранжирования. Алгоритм Google Panda оценивает качество контента на веб-сайтах и придает большую значимость высококачественным и оригинальным материалам, чтобы снизить видимость низкокачественных и дублированных страниц. Алгоритм Google Hummingbird улучшает понимание запросов пользователей и обеспечивает более точные и релевантные результаты поиска, учитывая контекст запроса и взаимосвязи между словами. Обновление алгоритма Mobile-Friendly Update оценивает мобильную дружественность веб-сайтов и предпочитает мобильно-оптимизированные сайты в поисковой выдаче на мобильных устройствах. Алгоритм Google RankBrain использует искусственный интеллект для анализа запросов пользователей и предоставления наиболее релевантных результатов, помогая Google понять семантическую связь и значения слов для более точной интерпретации запросов |

У Яндекса так же есть различные фильтры. Баден-Баден накладывается на большую часть страниц сайта или сразу весь домен. Обычно причиной является избыточное использование ключевых слов на продвигаемых страницах. С помощью АГС подавляют сайты-сателлиты, которые засоряют выдачу низкокачественным контентом. Ссылочный взрыв создан для борьбы с новыми сайтами, если для их продвижения приобретают чрезмерное количество внешних ссылок. Очень быстрый рост числа страниц, ссылающихся на такой новый сайт, вызывает подозрения у Яндекса. В результате он сразу обнаруживает такие ресурсы, применяя соответствующие меры. Минусинск оценивает ссылочный профиль и применяет санкции к сайтам, использующим нечестные методы продвижения. Переоптимизация применяется, если на странице сайта избыточно используются ключевые слова, и они подобраны неверно. Это может привести к негативным последствиям, таким как снижение позиций в поисковой выдаче на 5-20 пунктов для группы продвигаемых запросов, размещенных на одной странице. Аналитики Яндекса могут вручную ввести эту меру. Переспам применяется, если используется большое количество повторяющихся ключевых фраз и неестественных речевых оборотов. «Мобильный» фильтр призван ограничивать сайты, неподходящие для просмотра на мобильных устройствах. |

Нравится статья? Тогда смотрите наши курсы!

Заключение

Поисковые роботы играют ключевую роль в организации поисковой выдачи и ранжировании веб-сайтов. Они используют различные фильтры и алгоритмы, чтобы обеспечить безопасность, релевантность и качество результатов поиска. Знание и понимание алгоритмов поисковых роботов поможет оптимизировать веб-сайт и улучшить его видимость в поисковой выдаче.

Современные поисковые роботы уделяют внимание не только ключевым словам, но и другим факторам, таким как поведенческие метрики, экспертность контента, мобильная оптимизация и т.д.

Для веб-мастеров и владельцев сайтов важно следовать рекомендациям поисковых роботов и создавать уникальный, качественный контент. Также стоит учитывать требования к обеспечению безопасности и релевантность информации на сайте.

Если вам нужна помочь в поисковой оптимизации сайта, наши специалисты всегда готовы вам помочь. Сделаем все возможное, чтобы роботы Яндекса и Google правильно проиндексировали ваш сайт и показывали его на высоких позициях поисковой выдачи.

Программист

© 1PS.RU, при полном или частичном копировании материала ссылка на первоисточник обязательна